Règlement sur l’intelligence artificielle : état des lieux, niveaux de risques et avis d’experts

Une nouvelle chanson des Beatles, la découverte de géoglyphes au Pérou, le pilotage automatique des drones de livraison autonomes, le développement de thérapies non médicamenteuses…

Les applications concrètes et potentielles de l’intelligence artificielles sont de plus en plus nombreuses. Il en est de même pour les outils de l’IA accessibles au grand public, tels que ChatGPT, Dall-E, Midjourney, ou encore Bard. Ces outils sont capables de mener de nombreuses actions, entre la production de textes, d’images, de vidéos, et de voix.

Face à cette émergence et à cette utilisation massive de l’IA, les États-Unis, le Royaume-Uni, la Chine et l’Union Européenne souhaitent mettre en place un règlement sur l’intelligence artificielle.

L’IA Act : le projet de régulation européenne de l’IA

Le 14 juin dernier, le Parlement Européen a voté en faveur d’une initiative de régulation de l’intelligence artificielle, appelée l’IA Act, visant à créer un cadre juridique complet et uniforme sur la scène européenne, tant pour l’utilisation que la commercialisation des technologies d'intelligence artificielle.

En réalité, ce projet est en préparation depuis plusieurs années, avec une version initiale datant d’avril 2021. Toutefois, ce premier jet s’est vu confronté au lancement d’outils intelligents tels que ceux mentionnés plus haut. C’est notamment en novembre 2022 que ChatGPT s’ouvre au public, obligeant une nouvelle fois la Commission à adapter le texte du projet. Face à la complexité de l’intelligence artificielle et aux nombreuses technologies et domaines qu’elle englobe, ce texte est devenu le plus amendé de l'histoire de la législation européenne.

« Il a donc fallu que nous nous adaptions à cette nouvelle réalité sociétale en l'incluant dans les travaux parlementaires qui étaient en cours », reconnaît Geoffroy Didier, vice-président de la commission Intelligence artificielle au Parlement européen.

La prochaine étape de la mise en place de ce règlement européen sur l’intelligence artificielle repose sur les Etats membres, qui doivent encore négocier sur la version finale du texte et la législation qui limiteraient les risques des technologies de l’intelligence artificielle tout en favorisant l’innovation.

Ce texte pourrait être finalisé d'ici la fin de l'année, avant une entrée en application à horizon 2026.

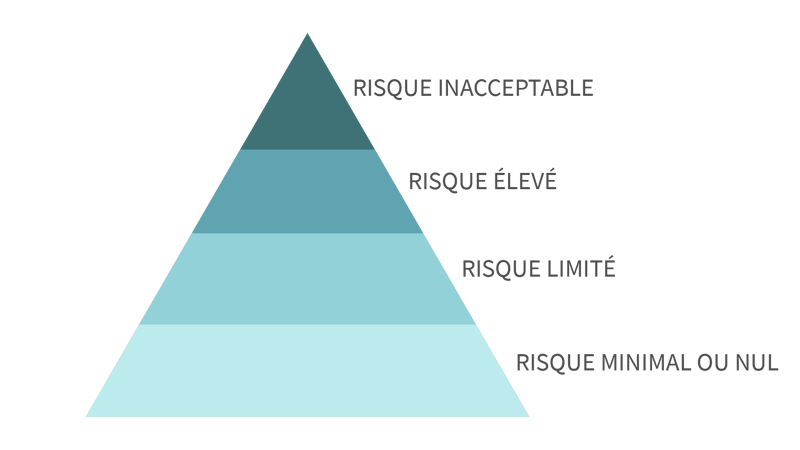

Une pyramide sur les niveaux de risques

Ce règlement sur l’intelligence artificielle détermine 4 niveaux de risques quant à l’utilisation et la commercialisation des technologies d'intelligence artificielle. Chacun de ces niveau amène une réponse législative différente.

Du plus faible au plus fort, les risques définis selon le règlement européen sur l’intelligence artificielle sont les suivants :

- Le risque minimal ou nul, qui ne nécessite pas de mesure particulière ;

- Le risque limité, avec des systèmes qui devront garantir un niveau élevé de protection des droits fondamentaux. Ce risque sera soumis à des obligations spécifiques ;

- Le risque élevé, pour lequel certaines mesures deviendront obligatoires, comme la mise en place d’une supervision humaine sur la machine, la création d'une documentation technique et/ou d'un système de gestion du risque. Une évaluation de la conformité par rapport à la réglementation devra avoir lieu, et des autorités de surveillance établies dans chaque pays membre auront le rôle de contrôler le respect de ces mesures ;

- Le risque inacceptable, qui regroupe les applications et usages les plus dangereux, contraires aux droits fondamentaux, et qui sont tout simplement interdits.

Parmi les risques inacceptables du règlement sur l’intelligence artificielle se retrouveront notamment :

- Le « scoring social », à savoir la notation sociale des individus, ou la classification des personnes selon leur comportement, leurs caractéristiques personnelles, leur statut socio-économique, etc. ;

- Les systèmes visant à manipuler les individus et entraînant des dommages physiques ou mentaux, ou exploitant les vulnérabilités des personnes ;

- Les systèmes exploitant les données biométriques, y compris l’utilisation en temps réel de systèmes d'identification biométrique à distance (par exemple, la reconnaissance faciale) par les forces de l'ordre dans des espaces publics accessibles.

- L'identification biométrique à distance « a posteriori » est également concernée, tout en prévoyant une exception pour les cas de poursuite d'infractions graves et uniquement après autorisation judiciaire.

- De la même façon, seront interdits les systèmes qui visent à collecter des informations biométriques depuis diverses sources dont les réseaux sociaux, avec comme objectif la création de bases de données.

Les risques élevés mentionnés dans le règlement européen sur l’intelligence artificielle représentent les outils qui, en cas de défaillance, pourraient créer un risque élevé pour la santé, la sécurité ou les droits fondamentaux des personnes physiques. Parmi ceux-ci se retrouveront notamment :

- Les systèmes liés aux ressources humaines, qui autorisent le recrutement, notamment via le tri des C.V. ;

- Les robots en chirurgie ;

- Les systèmes liés au domaine du transports ;

- Les systèmes liés au maintien de l’ordre, à la gestion des migrations et des frontières ;

- Les systèmes utilisés pour influencer les électeurs lors de campagnes politiques

La classification des robots conversationnels comme ChatGPT dans la catégorie « risque élevé » ou « risque inacceptable » n’est pas encore clairement définie.

Toutefois, certaines des obligations auxquelles seront soumis ces outils ont déjà été énoncées, dont :

- L’obligation de transparence, selon laquelle ces outils devront indiquer à leurs utilisateurs que leur contenu est généré par une IA et qu’ils ne conversent pas avec un humain ;

- La prévention de génération de contenu illégal ;

- La protection du droit d’auteur, en les obligeant à indiquer quels sont les contenus protégés par les droits d’auteur qui ont été utilisés lors de leur entraînement.

Les avis sur le règlement sur l’intelligence artificielle

En plus de cette régulation sur l’intelligence artificielle, en mars 2023, un moratoire de 6 mois a été demandé par des experts de l’IA quant aux recherches et évolutions sur les intelligences artificielles. La raison principale derrière cette demande concernait les « risques majeurs » que cette technologie pourrait faire courir à « l’humanité ».

Les exigences de ce moratoire, présenté sous la forme d’une pétition sur le site futureoflife.org, étaient les suivantes :

- La mise en place de systèmes de sécurité, avec de nouvelles autorités réglementaires dédiées ;

- La surveillance des systèmes d’IA ;

- Des techniques pour aider à distinguer le réel de l’artificiel ;

- Des institutions en mesure de gérer les « perturbations économiques et politiques dramatiques que l’IA provoquera».

Parmi ces experts se trouvaient notamment Elon Musk, CEO de Twitter et fondateur de SpaceX et de Tesla, Yuval Noah Harari, auteur de « Sapiens », et Sam Altman, patron d’OpenAI et créateur de ChatGPT. Celui-ci se dit « un petit peu effrayé » par l’application qu’il a lui-même conceptualisée, et redoute que celle-ci soit utilisée pour faire de « la désinformation à grande échelle ou des cyberattaques ».

Ces signataires de la pétition déclarent : « Ces derniers mois ont vu les laboratoires d’IA s’enfermer dans une course incontrôlée pour développer et déployer des cerveaux numériques toujours plus puissants, que personne – pas même leurs créateurs – ne peut comprendre, prédire ou contrôler de manière fiable ».

À échelle nationale, les expert belges de l’intelligence artificielle semblent s’accorder sur le fait qu’un règlement européen sur l’intelligence artificielle doive voir le jour, et que l’éducation à celle-ci est nécessaire. Toutefois, certains redoutent un cadre légal trop contraignant qui viendrait à freiner l’innovation.

- Cédric O, ancien secrétaire d'Etat au Numérique, déclare : « Le texte tel que proposé par le Parlement demande une telle surcharge administrative et il fait peser tellement de contraintes techniques sur ceux qui développent ou adoptent les technologies d'intelligence artificielle» . Or, il considère ceci comme une réelle problématique, « parce que c'est vraiment une révolution qui est proche de ce qu'on a connu avec l'automatisation dans les usines ou l'énergie nucléaire. Donc réguler, oui, mais il faut aussi faire en sorte qu'on ait des entreprises qui maîtrisent ces technologies ».

- Laurent Daudet est co-fondateur de la start-up LightOn, qui propose des logiciels aux entreprises pour automatiser certaines tâches. Selon lui, il faut trouver un juste milieu entre les règles établies pour les producteurs, et celles établies pour les utilisateurs : « Il faut bien établir la responsabilité du producteur de modèles qui ne livre pas un produit fini, il livre juste les briques technologiques. C'est l'utilisateur final qui lui va décider que cette brique technologique, il va l'utiliser pour faire une aide pour son moteur de recherche interne ou une aide pour faire la désinformation».

- Nathalie Smuha est chercheuse à la KU Leuven en matière de droit et éthique de la technologie. Pour elle, le risque de l’IA Act est qu’avec « une mauvaise régulation, on peut tuer tous les bénéfices que l’on peut en tirer. Et aussi, quels sont les risques que l’on est prêt à accepter dans notre société ?»

- Pour Grégory Renard, multi-entrepreneur et spécialiste du traitement du langage naturel, le moratoire de 6 mois n’est pas spécialement une bonne idée : « il est préférable de ne pas arrêter la recherche, de la laisser avancer et de justement continuer cette forme d’avancer relativement forte et majeure par rapport à cette technologie, mais par contre de réguler la mise en œuvre et de vérifier qu’elle soit mise en œuvre dans un cadre particulier».

Vous souhaitez en savoir plus sur l’intelligence artificielle, ses risques et opportunités pour votre entreprise ?

Découvrez l’atelier pratique « AI-VOLUTION : Application de l’intelligence artificielle en entreprise » !

Sources : https://www.francetvinfo.fr/replay-radio/le-choix-franceinfo/pour-que-ces-technologies-ne-soient-pas-utilisees-a-mauvais-escient-l-union-europeenne-propose-un-reglement-pour-reguler-les-intelligences-artificielles_5855474.html - https://www.rtl.fr/actu/sciences-tech/intelligence-artificielle-les-3-propositions-de-l-union-europeenne-pour-reguler-chatgpt-et-les-autres-systemes-7900274721 - https://www.rtbf.be/article/l-intelligence-artificielle-n-a-plus-besoin-de-modele-il-y-a-un-vrai-sujet-d-inquietude-11212478

Vous pourriez aussi aimer...

Ces articles en lien

Thierry Chantraine : "Il est naturel que la gestion de projet et la gestion du changement se rejoignent"

Stratégie de gamification : exemples et avantages